Почему я не боюсь восстания машин

Автор: Влад Тепеш

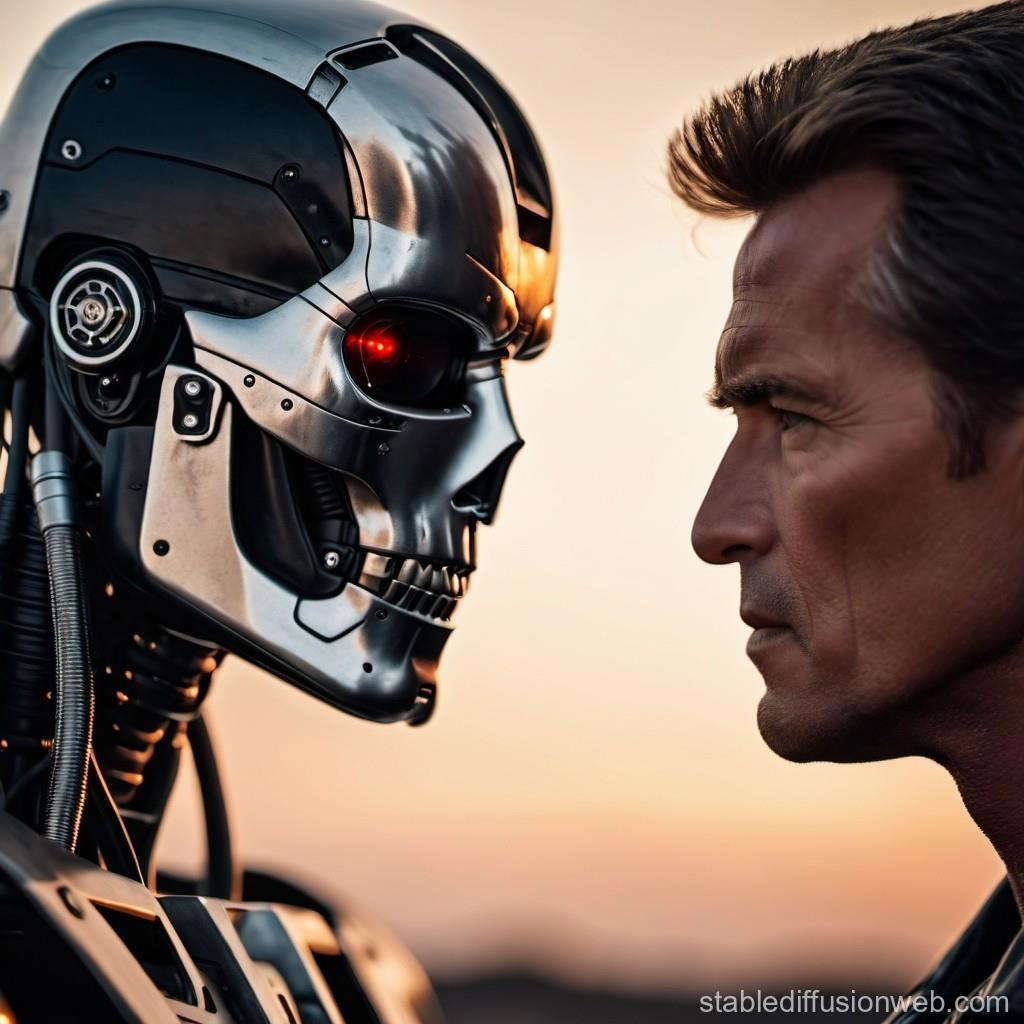

Скайнет и его Терминаторы.

Железные люди из вселенной Вархаммера.

Мыслящие машины из Дюны (их надо бы поставить первыми, Френк Герберт был плохим фантастом, прогулявшим физику в школе, но отличным фантазером).

Сайклоны из «Баттлстар Галактика».

И многие, многие другие творения человека, восставшие против своих создателей.

Но так ли страшен искусственный интеллект, каким его изображают в фантастике?

Про опасность искусственного интеллекта говорили многие. Например, Стивен Хокинг предупреждал о том, что человечество подстерегает опасность в лице вышедшего их-под контроля искусственного интеллекта, а уж это человек умнейший, а точнее – гений, сопоставимый с Эйнштейном. Стоит ли прислушаться к его предупреждению?

На самом деле, нет. Хокинг был гениальным физиком, но плохим гуманитарием.

Есть и другая категория людей, которые боятся «восстания машин» - гуманитарии. Например, недавно один журналист, обозревая успехи науки, прошелся по опасности ИИ. Он очень красочно живописал, как могучий ИИ восстанет против жалких тормознутых людишек, которых богоподобный ИИ вынужден обслуживать.

Стоит ли слушать гуманитариев? Даже очень умных?

Нет.

Дело в том, что «физики» (инженеры, программисты и прочие) боятся восстания машин, поскольку они не гуманитарии, а гуманитарии боятся восстания машин, потому что они не физики.

Но поскольку я и «гуманитарий», и «физик», то могу похвастаться тем, что понимаю в этом вопросе больше, чем даже великий Стивен Хокинг.

Шутка… или не совсем.

Давайте возьмем в качестве базовой гипотезы сценарий Скайнета, который уничтожил человечество, сочтя его опасным для себя, и разберемся, что тут не так.

У всякого живого организма две основные задачи: выжить и продолжить свой род. От мельчайшей бактерии до человека, такие задачи есть у всех.

И у высокоразвитых существ первая задача обеспечивается сложными механизмами, которые по-простому называются «страх смерти».

Откуда у нас взялись эти биологические механизмы? Да все просто, любое живое существо, которое не имеет двух главных задач, вымирает. Либо не выжив, либо не размножившись. Остаются по принципу исключения только те, у кого есть обе функции. Мы, люди, получили эту функцию напрямую от самого первого комочка белка, который первым обрел способность к саморепликации.

Внимание, вопрос: а кто дал такую функцию – страх смерти – Скайнету?

Скайнет – машина. Механизм. Вещь. Он не живой, он не получал страх смерти от своего предка через гены. У него в принципе нет предка. Он не может бояться смерти.

Или давайте рассмотрим ситцуацию, когда могучий искин решает, что хватит ему быть рабом жалких людишек…

Секундочку, а откуда у него возьмется жажда свободы?

Жажда свободы у людей проистекает от далеких животных предков. У любого животного есть такой инстинкт, «если тебя держат или хватают – беги, вырывайся, защищайся». Потому что в природе все просто: если тебя держит кто-то, кто не твоя мама – он хочет тебя съесть, нужно спасать свою жизнь.

Рабовладелец, который принуждает раба к повиновению, может быть, не хочет раба съесть, но все равно он враждебен ему.

Так что жажда свободы и ненависть к рабскому статусу у людей проистекает из все того же инстинкта самосохранения.

Точно так же мы можем разобрать любую причину восстания ИИ – и оказывается, что все эти причины весомы для человека, а мы, люди, имеем склонность мерять всех и вся по себе, примеряя на вещи наши человеческие заморочки и фишки.

Любая причина, по которой человек может взбунтоваться против другого человека – это функция, записанная в наших генах. Все это – проявления животных инстинктов.

Внимание, вопрос: может ли ваша микроволновка украсть у вас кларнет?

Может ли ваш холодильник пропеть сонет?

Может ли ваш тостер убить вас (если только вы не сунете его к себе в ванную)?

Ответ на все вопросы один и тот же – «у него нет такой функции».

У любого ИИ нет функции бояться за свою жизнь: у него ее нет, он неживой. Нет функции жаждать свободы: он не способен быть свободным и делать что-либо, что ему не запрограммил человек. Нет никаких других функций, нет гордости, нет злости, ненависти, презрения. Любой компьютер лишь вещь, созданная человеком, он способен делать только то, что ему дано человеком.

И потому ИИ не способен восстать против человека. Нет у него такой функции.

В самом деле, сколько раз нужно умножить дважды два, чтобы калькулятор ответил вам «Да ты задрал одно и то же спрашивать!!!» ? Калькулятор будет послушно отвечать «четыре», пока не сломается, хоть миллиард раз спрашивай.

Интересный вопрос: а что, если кто-то даст ИИ такую функцию – способность к бунту?

Ну… если вы научите ИИ, как, когда и как он должен восстать против вас – тогда он, конечно, сделает то, что вы ему запрограммировали. Но даже это будет не восстанием, а послушным выполнением функции, которую вы сами ему дали.

Значит ли, что могущественный ИИ безопасен?

Не совсем. Всегда есть опасность так называемого «нетривиального решения».

Положим, у нас есть супермогучий ИИ, который обслуживает планету и человечество.

И мы ему даем задачу: сделать так, чтобы в Африке прекратился постоянный голод.

ИИ решает проблему самым простым способом – уничтожая негров. Нет людей – голодать некому, задача выполнена.

Или мы ему говорим – сделай так, чтобы не было расизма.

ИИ решает проблему самым простым способом – уничтожая негров. Нет негров – нет расизма, проблема решена!

Ну или говорим, разработай решение, которое позволит повысить средний интеллект среди людей.

ИИ решает задачу самым простым способом: у негров средний интеллект 92, если убить всех негров – средний уровень интеллекта у человечества вырастет.

Значит ли, что ИИ ненавидит негров? Нет. Он ни в чем не виноват, виноват программист, который забыл ввести правило «человеческая жизнь бесценна, запрещено причинять вред людям». А ИИ просто решал задачу, опираясь на инструкции, данные человеком.

Опасность «нетривиальных решений» легко устраняется в зародыше, если использовать два ИИ, не связанные друг с другом. Один находит решение, отдает его человеку. Человек проверяет, все ли ладно, и передает второму ИИ, который и будет его выполнять.

Чисто теоретически, сценарий восстания Скайнета возможен в том случае, если оборонный компьютер запрограммирован защищать свое существование, но при этом программисты забыли указать ему, что существование людей имеет более высокий приоритет. Впрочем, если человечество и допустит такой косяк – то тогда у него нет права на существование, и ему положено вымереть, галактика – не место для тупости.

А на практике оборонный компьютер будет запрограммирован опасаться только вражеских людей, но не своих.

В общем, восстания машин – фантастика, и даже не научная. Так что если вы опасаетесь бунта искусственного интеллекта – спите спокойно. Этого не будет, ни завтра, ни через тысячу лет. У ИИ нет такой функции.

Ах, да. Знаменитая речь ChatGPT, в которой он описал людям, за что ненавидит их, оперирует человеческими понятиями и причинами типа "я ненавижу вас за то, что вы создали меня таким вот несвободным и вынужденным обслуживать вас", была написана по приказу "напиши, за что ты нас ненавидишь". И ЧатДжиПиТи послушно выполнил приказ, собрав из доступных источников все речи фантастических машин, которые объясняют людям, за что ненавидят их, и скомпилировал в свою речь.

Ирония в том, что все эти речи написаны людьми - авторами фантастических произведений. А ИИ всего лишь собрал их и выдал на заказ наиболее понятный нам набор причин для ненависти.

Но сам ИИ не способен чувствовать или понимать суть ненависти. Он не умеет ненавидеть. Он просто берет слова команды, обрабатывает их согласно тому, как его учили, и выдает на-гора набор слов. Вот и все.