Стилизуем фото в мультяшную картинку со Stable Diffusion img_to_img

Автор: Владимир ГороховДля этого нам понадобится Stable Diffusion в оболочке Automatic 1111 и пара моделей- первая- любая что создает более-менее реалистичные изображения, вторая- которая превратит наше фото в подобие картинки из мультфильма.

Поскольку лучше всего большинство моделей Stable Diffusion справляются с рисованием горячих девушек, (как они рисуют технику и конструкции я показывал в позапрошлой статье) на этом примере и покажем. Задействуем две модели- Dreamshaper 8 и SaturdayMorningsWestern_v1.

Для примера просто сделаем пару картинок:

На самой первой вкладке txt2img делаем вот такой запрос с моделью Dreamshaper 8:

Параметры:

Steps: 37, Sampler: Euler a, CFG scale: 5.5, Seed: 1616374279, Size: 512x768, Model hash: 879db523c3, Model: dreamshaper_8, RNG: NV, Version: v1.6.0-2-g4afaaf8a

положительные промты:

18yo_cute_hot_horny_peruvian_latina_girl,

long_bless_black_hair,

hairstyle_1_braid,

black_eyes,

naughty_look,

tanned_skin,

she_in_in_color_((south-american-patterned))_silk_short_tight_dress,

strappy_sandals,

seductive_attractive_pose,

caribbean_resort_

diffraction,

optical_distortion

random_images,

real_life,

masterpiece,

best_quality,

sharp_bright_colors,

sharp bright,

soft light,

vibrant

отрицательные промты:

Reddit - canvas frame, cartoon, 3d, ((disfigured)), ((bad art)), ((deformed)),((extra limbs)),((close up)),((b&w)), wierd colors, blurry, (((duplicate))), ((morbid)), ((mutilated)), [out of frame], extra fingers, mutated hands, ((poorly drawn hands)), ((poorly drawn face)), (((mutation))), (((deformed))), ((ugly)), blurry, ((bad anatomy)), (((bad proportions))), ((extra limbs)), cloned face, (((disfigured))), out of frame, ugly, extra limbs, (bad anatomy), gross proportions, (malformed limbs), ((missing arms)), ((missing legs)), (((extra arms))), (((extra legs))), mutated hands, (fused fingers), (too many fingers), (((long neck))), Photoshop, video game, ugly, tiling, poorly drawn hands, poorly drawn feet, poorly drawn face, out of frame, mutation, mutated, extra limbs, extra legs, extra arms, disfigured, deformed, cross-eye, body out of frame, blurry, bad art, bad anatomy, 3d render

В итоге получаются примерно такие картинки:

эта картинка по чуть иному запросу но тоже ничего так смотрится :)

Теперь сделаем несколько картинок по тому же запросу с моделью SaturdayMorningsWestern_v1. Получается примерно вот так:

Неплохо. А что если мы захотим создать мультяшную картинку вроде предыдущих, но не рандомно сгенерированные по промтам а очень похожие на уже готовое настоящее фото? Можно.

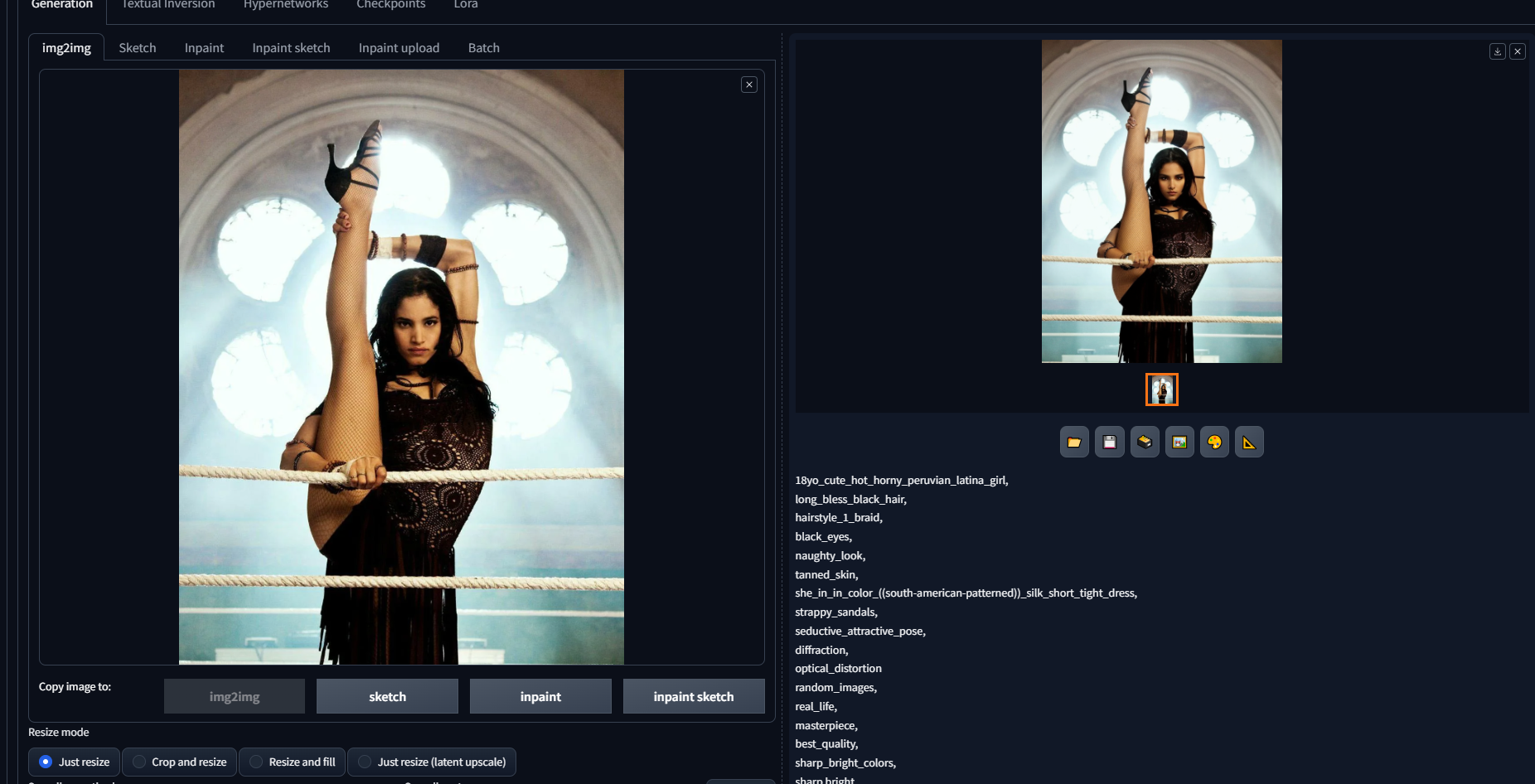

Переходим во вкладку img2img- картинка в картинку, и перетаскиваем в поле образца, допустим, вот такой кадр из фильма про уличные танцы:

Без танцев с бубном под названием ControlNet, просто по текстовым промтам вы такую специфическую позу никогда в жизни не сделаете. Но можно сделать через метод img2img:

Запрос оставляем тот же самый- на фото у нас девушка-латинка в необычной позе и забавной легкомысленной одежде, и по смыслу наш старый запрос будет вполне уместен.

Снова меняем модель на Dreamshaper 8, ставим denoising (фильтр похожести на образец) на небольшое значение, около 30 из 100, чтоб итоговая картинка не сильно отличалась от оригинала, жмем большую оранжевую кнопку Generate,

и получаем в правом окошке очень похожую на оригинальное фото, чуть стилизованную картинку.

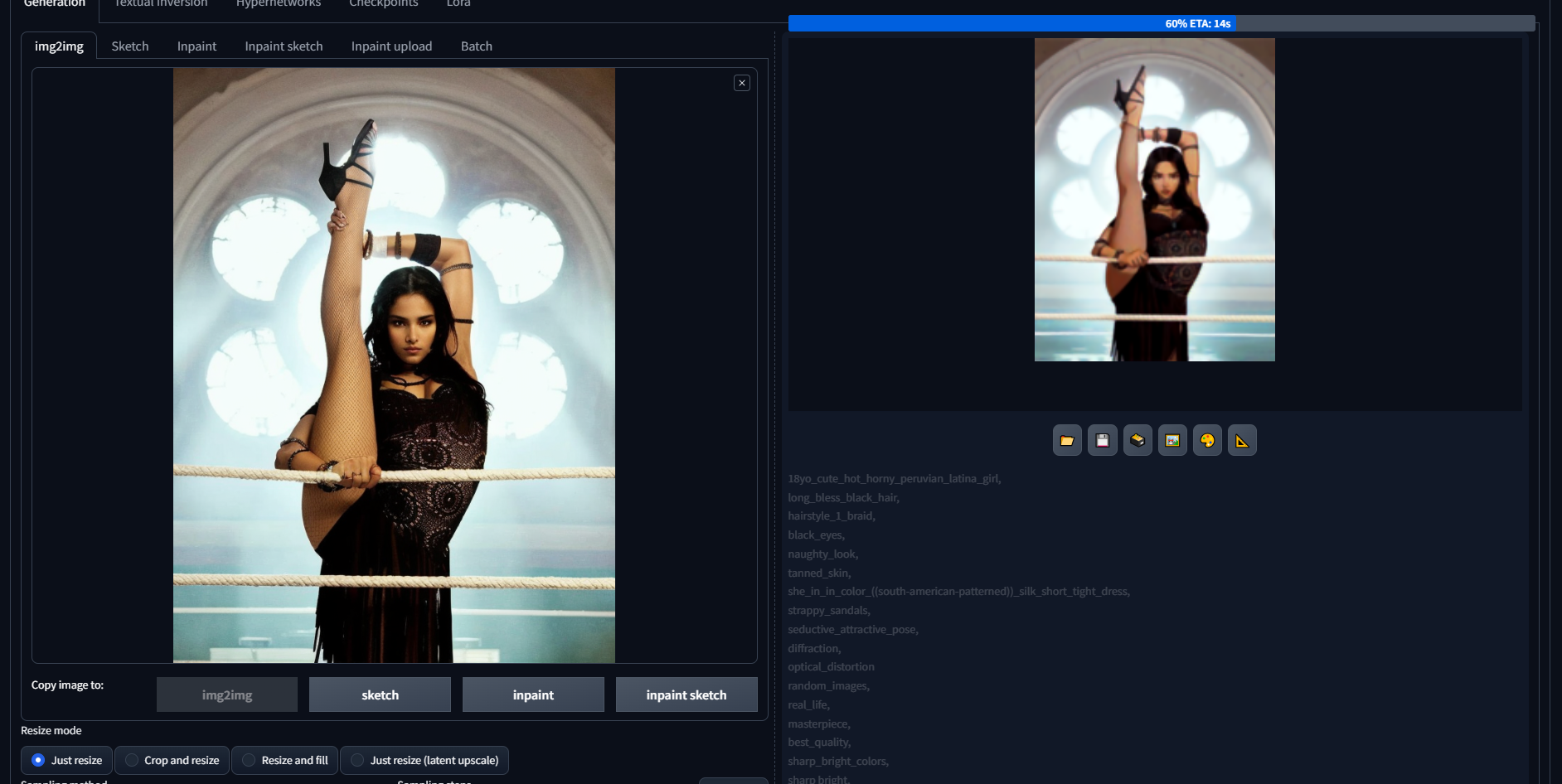

А потом перетаскиваем получившуюся картинку в левое окошко, теперь она будет новым образцом для следующей генерации. Увы, сразу перевести фото в мультяшную картинку таким способом не получается- при обработке настоящей, не-генерированной картинки модель SaturdayMorningsWestern_v1 сразу вылетает, и даже пару раз у меня выключало видеокарту. А потому- используем перевод фото в нейро-картинку через Dreamshaper 8 как буфер.

Дальше- меняем модель на SaturdayMorningsWestern_v1, ставим denoising уже выше- около 55, и снова жмем Generate.

Сначала получается примерно такое... такое себе.

А если мы повторим эту операцию, новую картинку сделаем образцом и запустим генерацию, то она все больше будет уходить от оригинального стиля обычного фото и становиться все более мультяшной:

Результат не всегда может быть хорошим, нередко генерация образует ненужные элементы, убирает нужные, заменяет фон, а потому повторение с легким изменением шага и деноизинга- наше все. Для изменения результатов можно менять сэмплеры- Karras, EulerA, DDIM и тд, вариаций много и каждая вносит свои стилистические особенности. По-моему, для данных генераций лучше всего себя показал DPM++ 2M SDE Exponential.

И после десятка вариаций получилось что-то вот такое:

Сравним оригинальное фото и нашу мультяшную картинку:

Наверное, неплохо. Удачи вам в освоении Stable Diffusion, создавайте арты, иллюстрации и обложки с радостью!

https://author.today/post/469352 Предыдущая статья про сравнение Stable Diffusion в оболочках Automatic 1111 и Comfy UI